Back Entropie (Inligtingsteorie) Afrikaans اعتلاج (نظرية المعلومات) Arabic Entropie (Informationstheorie) BAR Ентропия на Шанън Bulgarian Entropija (teorija informacija) BS ئانترۆپیی زانیاری CKB Informační entropie Czech Entropi gwybodaeth Welsh Entropi (informationsteori) Danish Entropie (Informationstheorie) German

L'entropia de Shannon, (formulada per Claude Shannon)[1][2] és una funció matemàtica que intuïtivament es correspon amb la quantitat d'informació continguda o lliurada per una font d'informació. Aquesta font pot ser un text escrit en un idioma determinat, un senyal elèctric, un fitxer d'ordinador o qualsevol (col·lecció de bytes). Des del punt de vista d'un receptor, com més informació diferent emet la font, més gran és l'entropia (o incertesa sobre el que emet la font), i viceversa. Com més informació rep el receptor sobre el missatge transmès, més disminueix l'entropia (incertesa) respecte aquest missatge, per raó d'aquest augment d'informació. La definició d'entropia de Shannon és tal que com més redundant sigui la font, menys informació conté. En absència de restriccions particulars, l'entropia és màxima per a una font en la que tots els símbols són igualment probables (equiprobables).

Donada una variable aleatòria discreta , que pren valors en l'alfabet i segueix una certa distribució :

|

|

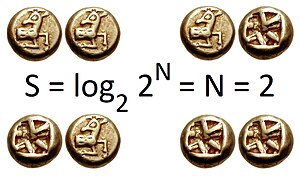

on denota la suma al llarg dels possibles valors de la variable aleatòria. La tria de base per , el logaritme, varia en funció de l'apliació. Usant la base 2, s'obté l'entropia en bits (o en "shannons"), mentre que la base e dona les "unitats naturals" nat, i la base 10 dona unitats de "dits", "bans", o "hartleys". Una definició equivalent de l'entropia és l'esperança de la auto-informació d'una variable.[3]

- ↑ Shannon, Claude E. «A Mathematical Theory of Communication». Bell System Technical Journal, 27, 3, 7-1948, pàg. 379–423. DOI: 10.1002/j.1538-7305.1948.tb01338.x. (PDF, archived from here)

- ↑ Shannon, Claude E. «A Mathematical Theory of Communication». Bell System Technical Journal, 27, 4, 10-1948, pàg. 623–656. DOI: 10.1002/j.1538-7305.1948.tb00917.x. (PDF, archived from here)

- ↑ Pathria, R. K.; Beale, Paul. Statistical Mechanics. Third. Academic Press, 2011, p. 51. ISBN 978-0123821881.

![{\displaystyle p:{\mathcal {X}}\to [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f219961c04ea0285eff7416f743c7684e0da25fa)